文章目錄

Toggle一、A/B 測試是什麼?行銷人必懂的實驗方法

A/B 測試(A/B Testing),也稱為分割測試(Split Testing),是一種將受眾隨機分成兩組,分別展示不同版本的內容(版本 A 和版本 B),然後比較哪個版本表現更好的實驗方法。這個方法廣泛應用在網頁設計、廣告投放、電子報行銷和產品開發等領域。

為什麼 A/B 測試這麼重要?因為在行銷的世界裡,「我覺得」和「數據顯示」往往是兩回事。你覺得紅色按鈕比藍色按鈕好看,但數據可能告訴你藍色按鈕的點擊率高出 30%。A/B 測試讓你用數據做決策,而不是靠直覺猜測。

根據 VWO 的研究,持續進行 A/B 測試的企業,平均轉換率比不做測試的企業高出 49%。這不是因為他們運氣好,而是因為他們透過不斷的小實驗,一步步找出最有效的行銷組合。

二、A/B 測試的運作原理

A/B 測試的基本流程是這樣的:首先,你選定一個想要測試的元素(例如 Landing Page 的標題)。然後,你製作兩個版本:版本 A 是原始版本(控制組),版本 B 是修改後的版本(實驗組)。接著,系統會隨機將流量平均分配給兩個版本。最後,你比較兩個版本的表現數據(如轉換率、點擊率),判斷哪個版本更好。

| 步驟 | 說明 | 注意事項 |

|---|---|---|

| 1. 提出假設 | 明確定義你要測試什麼、預期結果 | 假設要具體可驗證 |

| 2. 設計變體 | 製作 A 版(原始)和 B 版(修改) | 一次只改一個變數 |

| 3. 分配流量 | 隨機將訪客分配到兩個版本 | 確保 50/50 均分 |

| 4. 收集數據 | 追蹤各版本的關鍵指標 | 需要足夠的樣本量 |

| 5. 分析結果 | 判斷結果是否具有統計顯著性 | 信心水準至少 95% |

最關鍵的原則是:一次只測試一個變數。如果你同時改了標題、圖片和按鈕顏色,就算 B 版表現更好,你也不知道是哪個改動造成的差異。

三、A/B 測試可以測什麼?十個高影響力的測試項目

1. 標題和副標題

標題是訪客看到的第一個元素,對 CTR(點擊率)和轉換率有巨大影響。測試不同的標題寫法:問句 vs 陳述句、數字 vs 文字、痛點導向 vs 利益導向。

2. CTA 按鈕

CTA(Call to Action)按鈕是轉換的最後一步。可以測試的元素包括:按鈕文字(「立即購買」vs「加入購物車」)、按鈕顏色(紅色 vs 綠色)、按鈕大小和位置。

3. 頁面版面配置

測試不同的版面配置方式:單欄 vs 雙欄、圖片在左 vs 圖片在右、長頁面 vs 短頁面。版面配置會影響訪客的瀏覽動線和停留時間。

4. 圖片和影片

測試不同的視覺元素:產品照片 vs 使用情境照、靜態圖片 vs 影片、真人照片 vs 插畫。視覺元素對第一印象和情感連結有很大影響。

5. 表單設計

表單的欄位數量和設計直接影響填寫率。測試:三個欄位 vs 五個欄位、單步驟 vs 多步驟、有無即時驗證。

6. 定價和優惠方式

測試不同的定價呈現方式:原價劃掉顯示折扣價 vs 直接顯示折扣價、月付 vs 年付、免費試用 vs 退款保證。

7. 社會認證元素

測試不同的社會認證方式:客戶評價 vs 客戶數量、星等評分 vs 文字見證、品牌 Logo 牆 vs 案例研究。

8. 電子報主旨

EDM 電子報的開信率很大程度取決於主旨。測試不同的主旨寫法:個人化 vs 通用、急迫感 vs 好奇心、短主旨 vs 長主旨。

9. 廣告素材

在 Facebook 廣告和 Google Ads 中,測試不同的廣告文案、圖片和受眾定位,找出 ROAS 最高的組合。

10. 結帳流程

測試不同的結帳流程設計:訪客結帳 vs 強制註冊、單頁結帳 vs 多步驟結帳、有無進度條。結帳流程的優化可以有效降低購物車放棄率。

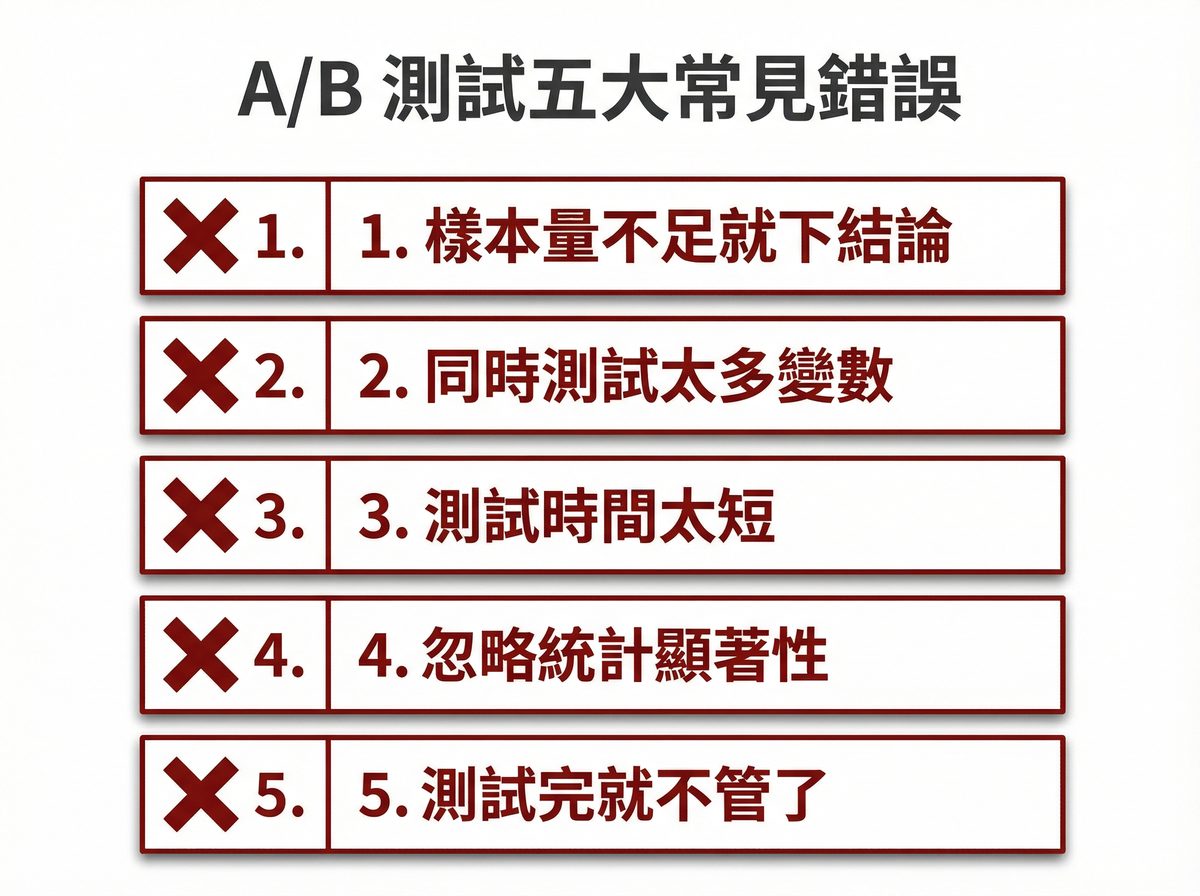

四、A/B 測試的五個常見錯誤(避坑指南)

錯誤一:樣本量不足就下結論

這是最常見的錯誤。如果你只有 100 個訪客就判斷哪個版本比較好,結果很可能是隨機波動而非真實差異。一般來說,每個版本至少需要 1,000 個以上的訪客,才能得到有統計意義的結果。具體的樣本量取決於你的基礎轉換率和預期提升幅度。

錯誤二:同時測試太多變數

如果你同時改了五個元素,就算結果有差異,你也不知道是哪個改動造成的。除非你使用多變量測試(MVT)並有足夠大的流量,否則一次只測試一個變數。

錯誤三:測試時間太短

至少要跑完一到兩個完整的業務週期(通常是一到兩週)。因為使用者行為會因為星期幾、節假日等因素而變化。只測試兩三天的結果可能不具代表性。

錯誤四:忽略統計顯著性

「B 版的轉換率比 A 版高 0.5%」不代表 B 版真的比較好。你需要確認這個差異具有統計顯著性(通常要求 95% 的信心水準)。可以使用線上的 A/B 測試計算器來判斷。

錯誤五:測試完就不管了

A/B 測試是持續的過程,不是做一次就結束。找到贏家版本後,應該繼續測試其他元素,持續優化。市場環境和使用者行為會隨時間改變,過去的贏家不一定永遠是贏家。

五、2026 最新整理:五款 A/B 測試工具比較

| 工具名稱 | 月費(起) | 適合對象 | 特色功能 |

|---|---|---|---|

| Google Optimize(已整合至 GA4) | 免費 | 中小企業入門 | 與 GA4 深度整合 |

| VWO | USD $99 | 中型企業 | 視覺化編輯器、熱點圖 |

| Optimizely | 客製報價 | 大型企業 | 進階多變量測試、AI 推薦 |

| AB Tasty | 客製報價 | 電商品牌 | 個人化推薦、Widget 功能 |

| Unbounce | USD $99 | Landing Page 測試 | AI 文案建議、Smart Traffic |

六、A/B 測試實戰案例解析

案例一:CTA 按鈕文字測試

某電商網站將「立即購買」改為「加入購物車,享免運優惠」,轉換率從 3.2% 提升到 4.8%,提升了 50%。原因是新版本的 CTA 降低了購買壓力(「加入購物車」比「立即購買」壓力小),同時加入了明確的利益點(免運優惠)。

案例二:Landing Page 標題測試

某 B2B 軟體公司測試了兩個標題:A 版「企業級專案管理工具」vs B 版「讓你的團隊效率提升 40% 的專案管理工具」。B 版的表單填寫率高出 35%。原因是 B 版用具體的數字和利益點取代了模糊的「企業級」描述。

案例三:電子報主旨測試

某品牌測試了兩個 EDM 主旨:A 版「本週新品上架」vs B 版「[姓名],為你挑選的三款新品」。B 版的開信率高出 28%。原因是個人化的主旨讓收件者感覺這封信是專門寫給他的,而不是群發的廣告。

七、常見問題 FAQ

Q1:A/B 測試需要多少流量才能做?

取決於你的基礎轉換率和預期提升幅度。一般來說,如果你的網站每月有 5,000 以上的訪客,就可以開始做 A/B 測試。流量越大,測試結果越快出來、越可靠。

Q2:A/B 測試要跑多久?

至少一到兩週,確保涵蓋完整的業務週期。如果流量較小,可能需要跑更久。不要在達到統計顯著性之前就停止測試。

Q3:A/B 測試和多變量測試有什麼不同?

A/B 測試一次只測試一個變數的兩個版本,多變量測試(MVT)可以同時測試多個變數的多個組合。MVT 需要更大的流量才能得到有意義的結果,適合高流量的網站。

Q4:每次 A/B 測試都要有統計顯著性嗎?

理想情況下是的。如果測試結果沒有達到統計顯著性,代表兩個版本的差異可能只是隨機波動。這時候你可以選擇繼續跑測試(增加樣本量),或者接受兩個版本表現差不多的結論。

Q5:小公司沒有專業團隊也能做 A/B 測試嗎?

可以。現在很多 A/B 測試工具都提供視覺化編輯器,不需要寫程式就能設定測試。從簡單的元素開始(如 CTA 按鈕文字),逐步累積經驗和數據。

八、讓專業團隊幫你建立數據導向的行銷策略

A/B 測試只是數據導向行銷的一部分。要真正提升行銷效益,需要從 SEO 優化、廣告投放到轉換率優化的全面配合。戰國策集團擁有超過 25 年的數位行銷實戰經驗,協助企業建立以數據為基礎的行銷決策系統,從流量獲取到轉換優化,每一步都有數據支撐。

選擇戰國策的五大優勢

- SEO關鍵字優化規劃 → 找出高潛力、高轉換率的詞庫,避免無效操作

- AI內容行銷優化 → 打造能被 Google 與 AI(ChatGPT、Perplexity)引用的結構化內容

- 技術 SEO → Schema、網站速度、行動體驗全面提升

- 外部連結建設 → 提升網站權重,建立長期穩定流量

- 跨國 SEO 佈局 → 不只台灣,包含美國SEO、馬來西亞SEO、新加坡SEO、印尼SEO,多語系全方位部署